인스타그램이 10대 이용자가 자살이나 자해 관련 용어를 반복적으로 검색할 경우 부모에게 알림을 보내는 기능을 도입한다고 밝혔다. 이 기능은 모회사인 메타 플랫폼스(Meta Platforms Inc.)가 여러 재판과 규제 심사에 직면한 가운데 시범적으로 도입되는 것이다.

2026년 2월 26일, CNBC뉴스의 보도에 따르면, 인스타그램은 목요일 성명을 통해 “이 알림은 부모가 자녀가 이러한 내용을 반복적으로 검색하고 있다는 사실을 인지하고, 자녀를 지원하는 데 필요한 자원을 제공하기 위한 것”이라고 밝혔다.1

인스타그램은 해당 알림을 다음 주부터 미국(US), 영국(UK), 호주(Australia), 캐나다(Canada)에서 순차적으로 제공할 예정이라고 밝혔다. 회사는 부모가 그들의 10대 자녀가 짧은 기간(“short period of time”) 동안 “자살 또는 자해를 조장하는 문구, 스스로 해를 입히려는 의사를 시사하는 문구, ‘suicide’ 혹은 ‘self-harm’ 같은 용어”를 반복 검색할 경우 알림을 받는다고 설명했다.

“These alerts are designed to make sure parents are aware if their teen is repeatedly trying to search for this content, and to give them the resources they need to support their teen,”

회사 측은 이 기능을 보낼 적정 기준(threshold)을 찾기 위한 “올바른 출발점(the right starting point)”이라고 지칭하면서, 알림이 반드시 실제 우려가 있는 상황을 의미하지 않을 수 있음을 인정했다. 메타는 사용자의 피드백을 계속 수렴할 것이라고 덧붙였다.

알림 전달 방식은 이메일, 문자메시지(text), 왓츠앱(WhatsApp), 인스타그램 내 메시지 등 다양한 채널을 통해 이루어진다. 다만 이 기능은 부모와 10대 이용자 모두가 인스타그램의 ‘부모 감독(Parental Supervision)’ 도구에 등록해야만 활성화된다. 부모가 알림을 받을 경우 자녀의 검색 습관에 관해 설명하는 메시지를 받으며, 추가적인 도움 자원을 확인하는 옵션을 제공받게 된다.

배경 및 재판 상황

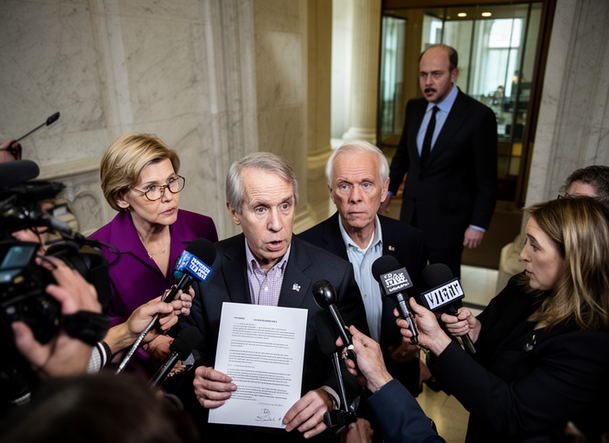

이번 기능 발표는 메타가 인스타그램 등 소셜미디어 앱의 설계와 기능이 청소년 정신건강에 악영향을 미친다는 혐의를 받으며 여러 법적 공방을 겪는 가운데 이뤄졌다. 업계 전문가들은 구글의 유튜브(YouTube), 틱톡(TikTok), 스냅(Snap)을 포함한 소셜미디어 관련 소송을 “빅토바코(빅 테크의 중대한 전환점)”에 비유하며, 법원이 제품의 잠재적 해로움과 기업의 정보 공개 여부를 심리하고 있다고 평가한다.

메타의 최고경영자(CEO) 마크 저커버그(Mark Zuckerberg)는 지난 2026년 2월 18일 로스앤젤레스(Los Angeles) 카운티 고등법원(Los Angeles Superior Court)에서 열린 공판에서 증언했다. 해당 재판의 원고는 자신이 미성년 시절 인스타그램 등 소셜미디어에 중독되었다고 주장하고 있다. 저커버그는 증언 과정에서 운영체제(OS)와 앱스토어 소유자(예: 애플(Apple), 구글(Google))가 이용자 연령을 확인하는 데 더 적합하다고 주장했다.

규제 동향 및 법적 쟁점

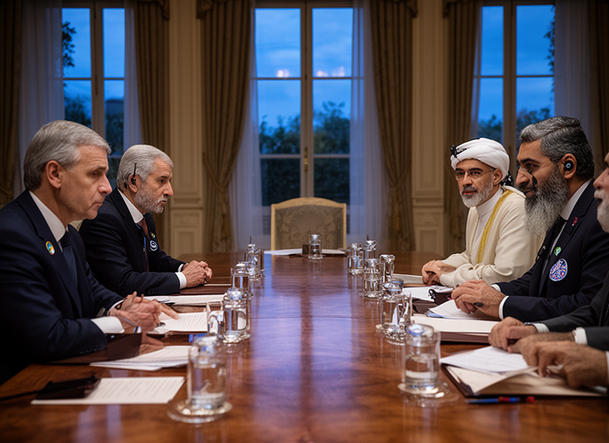

연방거래위원회(Federal Trade Commission, FTC)는 2026년 2월 중 일부 웹사이트와 온라인 서비스 사업자에 대해 아동 온라인 개인정보 보호 규칙(Children’s Online Privacy Protection Act Rule, COPPA Rule)과 관련한 집행을 유예하는 정책 성명을 발표했다. FTC는 연령 확인 기술에 정보를 제공할 수 있는 사용자 데이터 수집과 관련한 규칙 검토의 일환으로 이 같은 조치를 취한다고 밝혔다. COPPA는 주로 13세 미만 아동의 온라인 개인정보 보호를 규율하는 미국의 법 제도이며, 연령 확인(age verification)은 서비스 제공자가 미성년자 여부를 확인하기 위해 사용하는 방법을 말한다.

또한, 뉴멕시코(New Mexico)에서 진행 중인 별도의 재판에서 공개된 법적 문서들은 메타 내부 직원들이 암호화(encryption) 노력으로 인해 아동 성착취물 관련 보고를 당국에 제공하는 것이 더 어려워질 수 있다고 논의한 내부 메시지를 포함하고 있다. 메타는 캘리포니아와 뉴멕시코 사건 모두에서 혐의를 부인하고 있다.

AI 관련 향후 계획

메타는 장기적으로 특정 AI 경험과 관련된 부모 알림도 도입할 계획이라고 밝혔다. 회사는 “일부 AI 경험에 대해, 10대가 자살 또는 자해와 관련된 특정 유형의 대화에 관여하려고 시도할 경우 보호자에게 알리도록 설계된” 알림을 순차적으로 추가할 예정이라고 말했다. 이러한 발표는 오픈AI(OpenAI) 등 다양한 기술회사의 AI 챗봇이 정신건강 관련 대화에서 문제가 될 소지가 있다는 우려가 커진 가운데 나왔다. 메타는 자체 AI 챗봇을 운영하고 있으며, 코드네임 ‘Avocado’로 불리는 강력한 AI 모델을 올해 중 공개할 계획이라고 알려졌다.

전문가 설명: COPPA와 연령 확인, 그리고 ‘부모 감독’ 도구란

아래는 일반 독자들이 이해하기 쉽도록 관련 용어를 설명한 보충 설명이다. COPPA(Children’s Online Privacy Protection Act)는 주로 13세 미만 아동의 개인정보 수집을 규제하는 미국 연방법이다. 연령 확인(age verification)은 서비스 제공자가 이용자의 실제 연령을 확인해 아동에게 유해할 수 있는 기능을 제한하거나 부모 동의를 받는 절차를 말한다. 인스타그램의 ‘부모 감독(Parental Supervision)’ 도구는 부모가 자녀의 활동을 일정 부분 모니터링하거나 통제할 수 있도록 설계된 기능군을 통칭한다. 이 도구들은 부모와 자녀가 모두 등록해야 기능이 활성화되며, 개인 정보 및 사용 습관에 대한 접근 권한은 서비스 약관과 플랫폼 정책에 따라 제한된다.

국내외 사회적·경제적 함의(분석)

이번 알림 기능 도입은 몇 가지 실질적·제도적 영향을 가질 가능성이 있다. 첫째, 규제당국과 법원에서 메타의 책임을 평가하는 과정에서 회사가 취한 보호 조치가 향후 판결의 고려사항이 될 수 있다. 둘째, 부모와 보호자 대상의 기능 강화는 플랫폼에 대한 신뢰 회복을 시도하는 동시에 청소년 이용률과 참여 패턴에 변화를 초래할 수 있다. 광고·마케팅 측면에서는 연령층별 타겟팅 전략과 개인정보 활용 정책의 재검토가 불가피하며, 이는 플랫폼의 광고 수익 구조와 단기적 매출에 영향을 미칠 수 있다. 셋째, 비즈니스 파트너십 측면에서 National Parent Teacher Association이 메타와의 자금 지원 관계를 갱신하지 않기로 한 결정은 기업의 학교·교육 관련 프로그램 수행에 제약을 줄 수 있다.

그렇지만 알림이 오탐(false positive)을 포함할 수 있다는 점에서 사용자 경험(UX)에 미치는 영향과 과도한 부모 개입으로 인한 프라이버시·신뢰 문제도 동시에 제기될 가능성이 있다. 기술적 한계와 윤리적 고려 사항을 어떻게 조율하느냐가 향후 기능의 수용성과 규제 대응의 핵심 변수가 될 전망이다.

도움이 필요할 경우

기사가 제공한 정보에 따르면, 자살 충동이나 심각한 고통을 경험하고 있다면 자살 및 위기 지원 라인(Suicide & Crisis Lifeline)에 연락할 것을 권고했다. 해당 라인은 미국의 경우 전화번호 988로, 훈련된 상담원의 지원을 받을 수 있다.

메타는 이번 인스타그램의 부모 알림 기능을 통해 자녀 안전 문제에 대한 즉각적인 대응체계를 강화하려고 시도하고 있다. 다만 이 조치가 광범위한 법적·사회적 우려를 해소할 수 있을지는 계속되는 재판과 규제 검토, 사용자·보호자들의 피드백에 달려 있다.